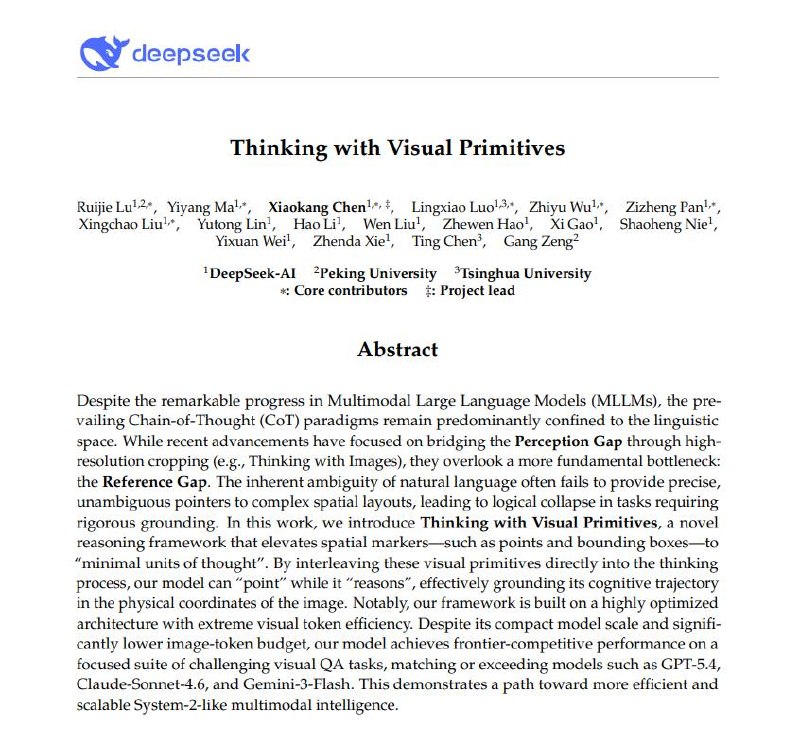

DeepSeek предложили новый способ улучшить мультимодальные модели

DeepSeek предложили новый способ улучшить мультимодальные модели

Сейчас модели нормально “видят” изображение, но рассуждают о нем через текст. Из-за этого они теряют точную привязку к объектам и начинают путаться в сложных сценах. В статье это называют Reference Gap.

Решение довольно прямое. Вместо чисто текстового ризонинга модель вставляет в процесс координаты. Это точки, чтобы вести путь по изображению, и рамки вокруг объектов. Сначала модель фиксирует, на что смотрит, потом строит рассуждение уже на этих привязках.

Архитектура при этом стандартная. ViT кодирует изображение, дальше все идет в MoE LLM. Новое именно в том, что визуальные примитивы становятся частью chain-of-thought, а не просто выходом модели.

Лучше всего это работает в задачах, где важна структура. Подсчет объектов, пространственные сравнения, лабиринты, трассировка линий.

Интересно, что DeepSeek довольно быстро удалил статью без объяснения причин. Скорее всего случился преждевременный релиз, а может и финальные результаты будут изменены. В любом случае (зеркало):

Вставить свои 5 копеек: