Джон Мюллер из Google только что выдал в LinkedIn вещь, которую большинство…

Джон Мюллер из Google только что выдал в LinkedIn вещь, которую большинство сеошников скипнули.

"Я настоятельно рекомендую не полагаться на попытки форсировать индексацию".

Два предложения.

Огромные последствия.

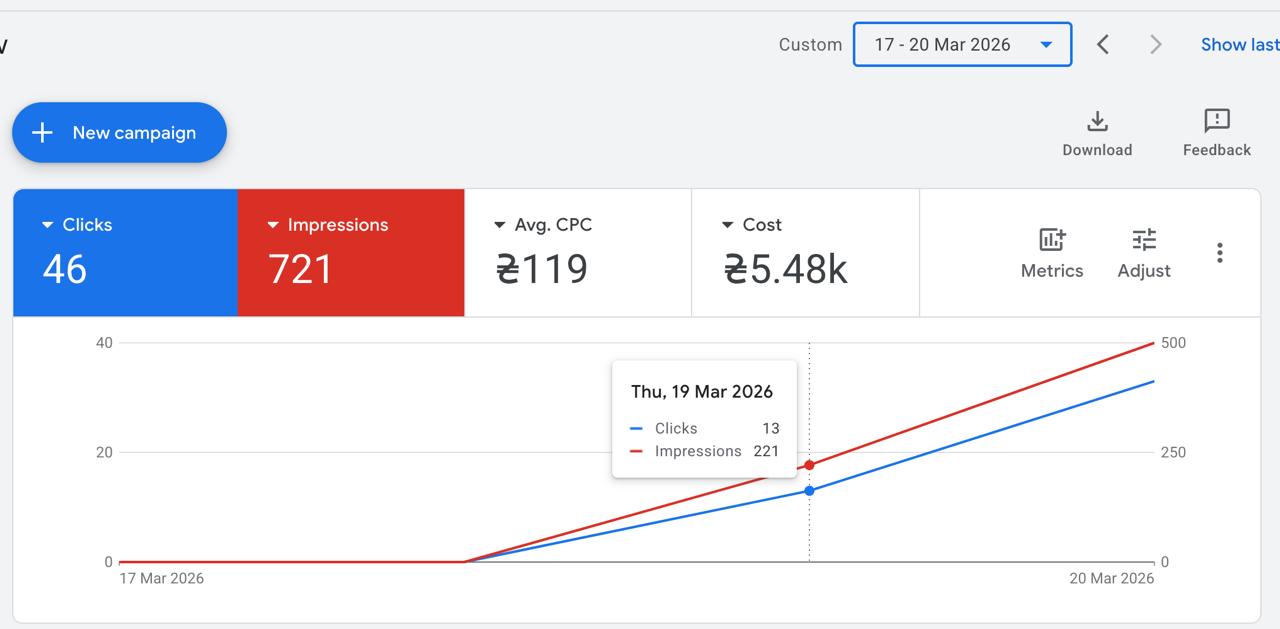

Стандартное SEO предполагает, что отправка урлов в GSC решает задержки с видимостью, но полевые данные по 16 миллионам страниц раскрывают системный фильтр качества: 62% отслеживаемых страниц отклоняются сразу, только 37% индексируются, и 21% из них впоследствии деиндексируются.

Кор-апдейт за март 2024 года снес 45% малоценного контента, подтверждая, что индекс работает как жесткий гейт качества, а не как слой обнаружения.

Форсирование ручной индексации для урлов, застрявших в статусах Discovered, currently not indexed или Crawled, currently not indexed, обучает классификатор пессимизировать домен и сжигает краулинговый бюджет.

Поскольку Google оценивает качество всего сайта до отдельных страниц, один раздел малоценного контента активно режет пропускную способность индексации по всей архитектуре домена.

Google маскирует эти хостовые реджекты по качеству за размытыми статусами в консоли, но эта слепая зона обходится через вооружение альтернативными логами вебмастеров в качестве диагностических прокси.

Bing Webmaster Tools явно помечает отклоненные урлы флагом Content Quality внутри своего отчета XML Sitemap Coverage Report.

Яндекс Вебмастер изолирует конкретные механики сбоя под статусом Low-value or low-demand pages, окончательно отделяя урлы, выкинутые за дефекты контента, от страниц, исключенных тупо из-за нулевых пользовательских поисков.

Более того, Яндекс раскрывает метрику Site Quality Index (SQI), форсируя видимость того, как алгоритмические оценки качества бьются напрямую с доменами конкурентов.

Выгрузка списка зависших урлов из GSC и их кросс-чек с флагами качества Bing и логами исключений Яндекса разоблачает точные урлы, которые тянут вниз хостовую оценку Google.

Нейтрализация этих конкретно помеченных страниц обязательна, потому что индексация теперь диктует тотальную AI-видимость.

AI Overviews и AI Mode от Google тянут данные исключительно из проиндексированного контента, цитации ChatGPT напрямую коррелируют с трастом и глубиной домена, а индекс Bing кормит Microsoft Copilot.

Если Bing или Яндекс помечают контент как некачественный, домен фактически стирается как из традиционных поисковых слоев, так и из AI-движков ответов.

#Indexing #IndexCoverage #CrawlBudget

@MikeBlazerX

🚷 Закрытый канал: @MikeBlazerPRO

Вставить свои 5 копеек: