мета выпустила ИИ, который моделирует реакцию мозга на зрительные и звуковые стимулы без участия реального человека

мета выпустила ИИ, который моделирует реакцию мозга на зрительные и звуковые стимулы без участия реального человека

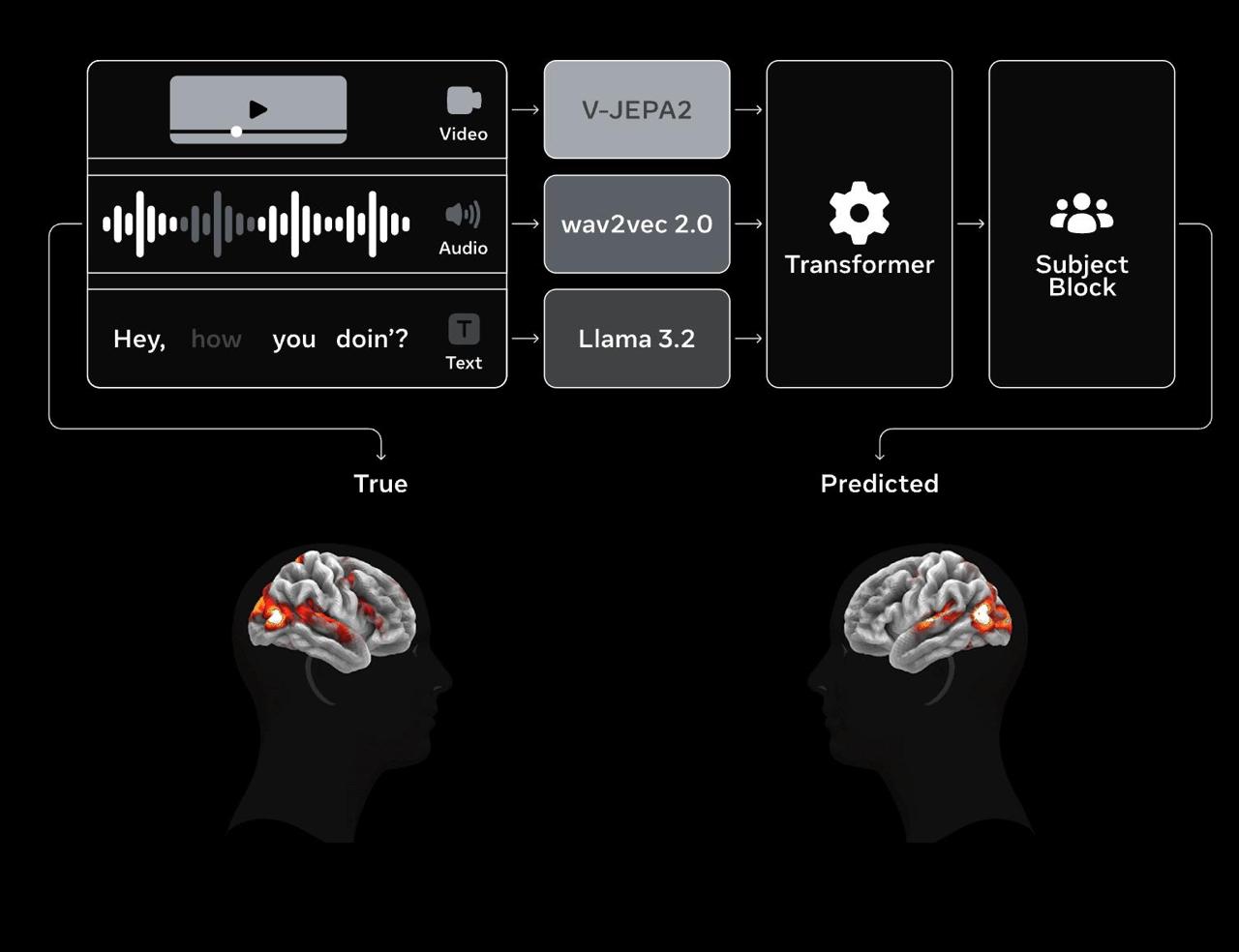

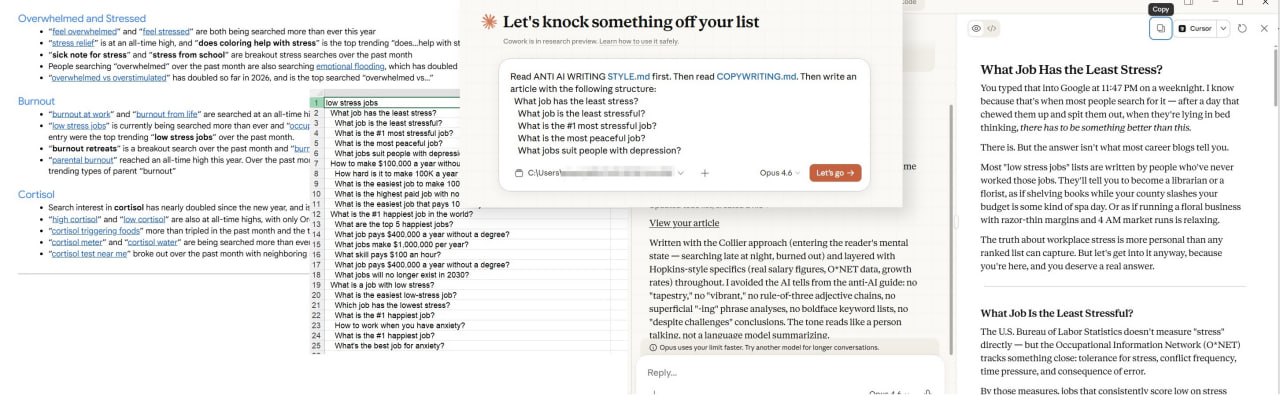

TRIBE v2 это новая модель ии от Meta, которая выступает как «цифровой двойник» активности человеческого мозга.

они обучили ее на дате собранной с 700+ человек — показывали картинки, видео, текст, давали слушать подкасты, модель училась предсказывать активность мозга в ответ на каждый стимул. точность в 70 раз выше предыдущих аналогов, модель и код выложили в открытый доступ.

сразу возникла мысль — а что если скормить туда наши креативы, замерить реакцию мозга, и отдавать в промо тот, на который была самая сильная активация. потом усложнить — понять, почему именно этот крео зацепил и на основе этого производить новые.

красивая идея. но есть нюанс.

TRIBE v2 отдаёт сырые объемные fMRI-данные. преобразовать их в логику типа «креатив А лучше креатива Б» — это задача PhD-уровня, до которой AI пока не добрался. так что как инструмент для нейромаркетинга в лоб это пока не работает.

при этом — ориентироваться на то, какие зоны мозга активируются при просмотре конкретного креатива уже можно. это не готовый answer, но направление интересное.

и пока мы это разбираем — нашли рабочий инструмент для тех, кто хочет тестировать креативы через нейро уже сейчас. http://neuronsinc.com/ — не дешево, но вроде работает. советовали сильные ребята из екома.

статья меты тут с презентацией и возможностью выкачать модель тут→ http://ai.meta.com/blog/tribe-v2-brain-predictive-foundation-model

@sirka_cpa #новости

Вставить свои 5 копеек: