OpenMythos: известный инженер и создатель Swarms воссоздал предполагаемую архитектуру Claude Mythos и…

OpenMythos: известный инженер и создатель Swarms воссоздал предполагаемую архитектуру Claude Mythos и набрал уже 3.3к звезд на GitHub

https://github.com/kyegomez/OpenMythos

Дисклеймер: это именно предполагаемая архитекутра. Никаких сливов вокруг модели (вроде как) не было, а это – просто реализация гипотезы, основанной на открытых данных, статьях и мнениях авторитетных граждан соцсетей.

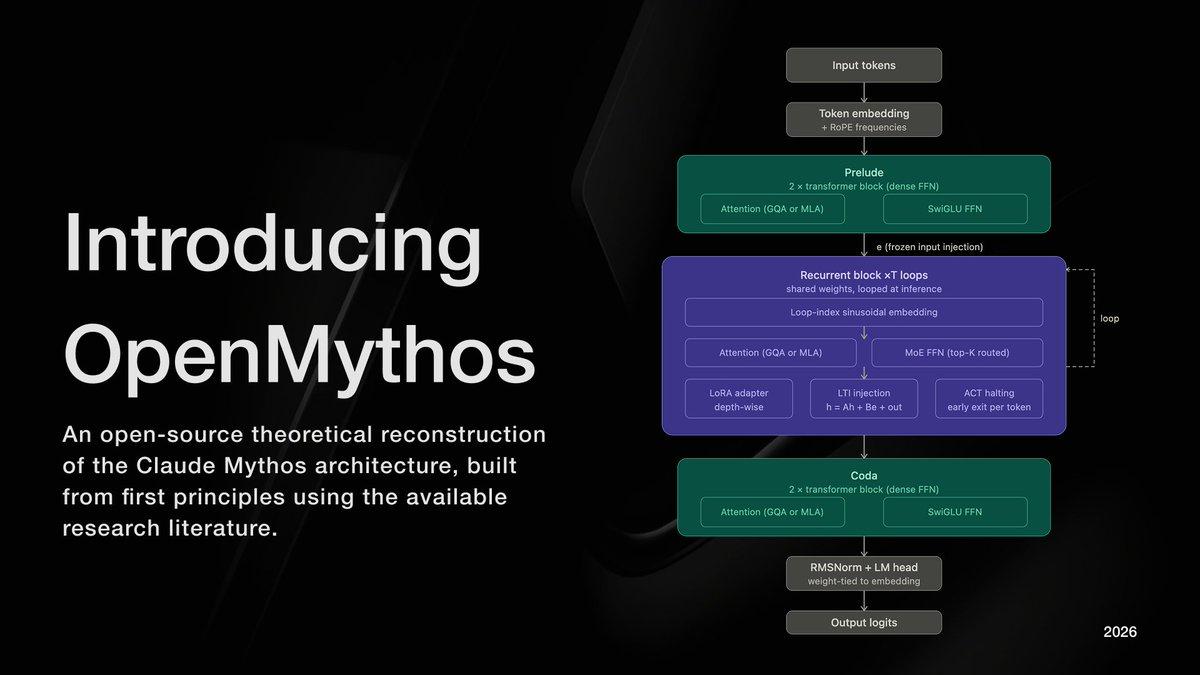

Автор утверждает, что модель построена на архитектуре Recurrent‑Depth Transformer (RDT) с MoE‑роутингом и адаптивным вычислением. Модель делится на три крупных блока:

1. Prelude – обычные слои трансформера, к которым мы привыкли в современных моделях. Они работают ровно один раз, обрабатывают входные данные и инициализируют скрытые состояния.

2. Recurrent Block. Вот тут уже начинается новизна. Это один и тот же блок слоев, который применяется по кругу N раз. То есть в такой модели глубина нейросети получается не за счет множества разных слоев, а за счет многократного прохождения одного блока. Надо сказать, что на каждом шаге еще учитываются LoRA‑адаптеры по глубине, так что каждый шаг цикла вычислительно уникальный, хотя базовые веса одни и те же.

3. Coda – заключительные слои, которые работают еще один раз после цикла, чтобы сформировать финальные логиты.

Это идея так называемого рекуррентного рассуждения в латентном пространстве. Мы уходим от привычного ризонинга chain‑of‑thought в токен‑пространстве к гибкому ризонингу в скрытых слоях. Если нужно думать дольше, модель не генерирует больше токенов, а наращивает количество внутренних прогонов, уточняя ответ.

Красивая гипотеза, конечно. Верить ей или нет, решать вам.

Весь код можно покрутить вот здесь. В исходной имплементации в модели всего 770M параметров, но другие разработчики уже начинают скейлить идею и проверять архитектуру на более крупных моделях. Интересно, что из этого выйдет.

Вставить свои 5 копеек: