Ян Лекун резко шагнул вперед в изобретении универсальной архитектуры для world models

Ян Лекун резко шагнул вперед в изобретении универсальной архитектуры для world models

Очень многие точно слышали про JEPA. Расшифровывается JEPA как Joint Embedding Predictive Architecture – Self-Supervised архитектура, предназначенная для понимания внешнего физического мира.

Идея там красивая: вместо предсказания следующего токена или генерации пикселей JEPA пытается предсказывать смысл наблюдаемого фрагмента на основе контекста (по факту это предсказание эмбеддингов).

Лекун считает, что это идеалогическая альтернатива привычному ИИ, потому что предсказание пикселей или токенов – это лишь имитация понимания структуры мира, а тут модель действительно учится понимать физику и логические связи.

Все это здорово, но основная проблема в том, что JEPA очень плохо обучается: лосс почти всегда схлопывается в тривиальное решение и реальной world model не получается.

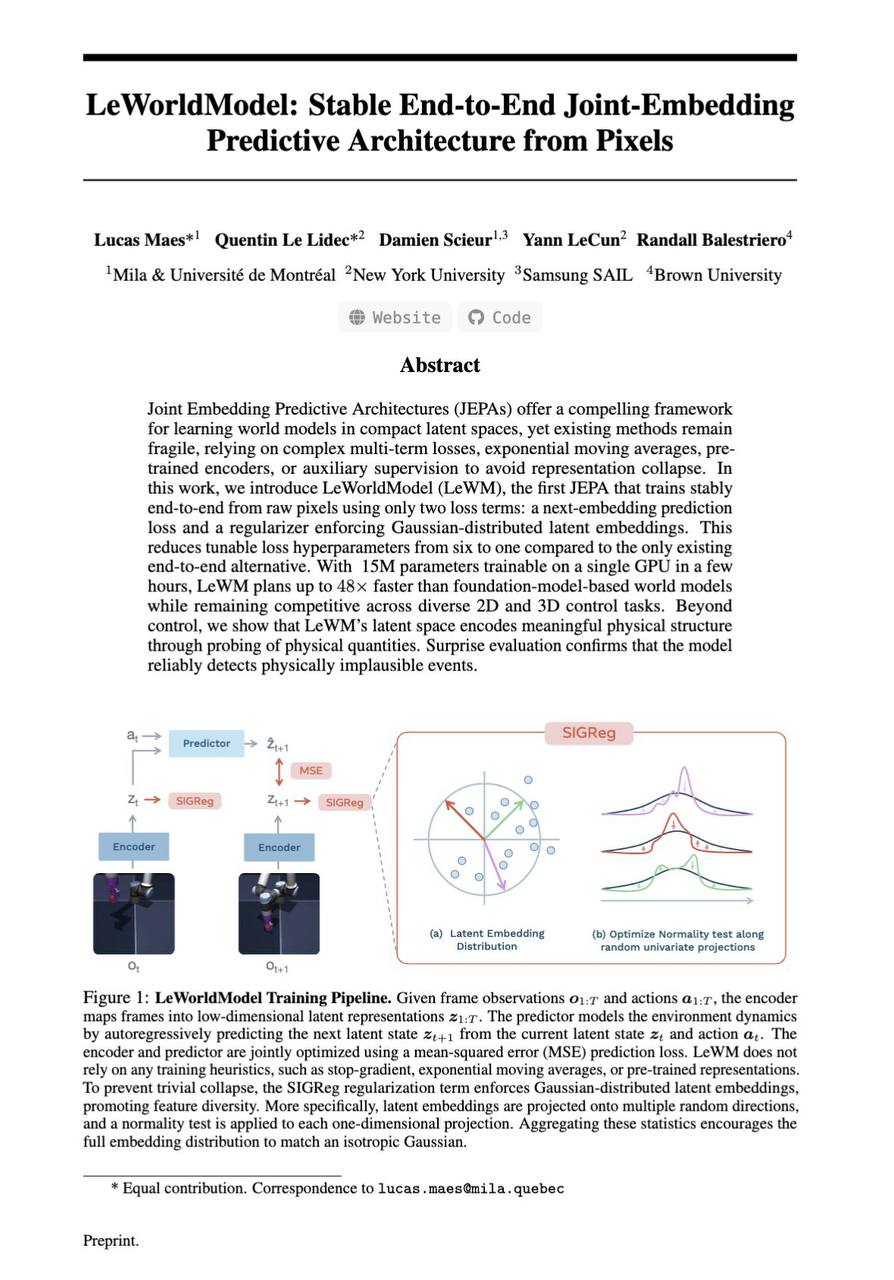

Но кажется, теперь это препятствие разрушено. Лекун с соавторами выпустили статью, в которой представлена первая end-to-end JEPA, которая обучается из сырых изображений без эвристик, сложных лоссов и прочих танцев с бубном.

Модель красиво называется LeWorldModel (LeWM), и в ней всего 15М параметров. От коллапсов при обучении она защищается очень простым способом: кроме лосса на предсказание следующего latent-state, добавляется регуляризатор, который заставляет латенты быть похожими на изотропное гауссово распределение. Это и есть главный технический ход статьи.

На практике это значит, что рецепт, который раньше был капризным и дорогим в настройке, упростился настолько, что world models наконец-то можно скейлить во что-то рабочее.

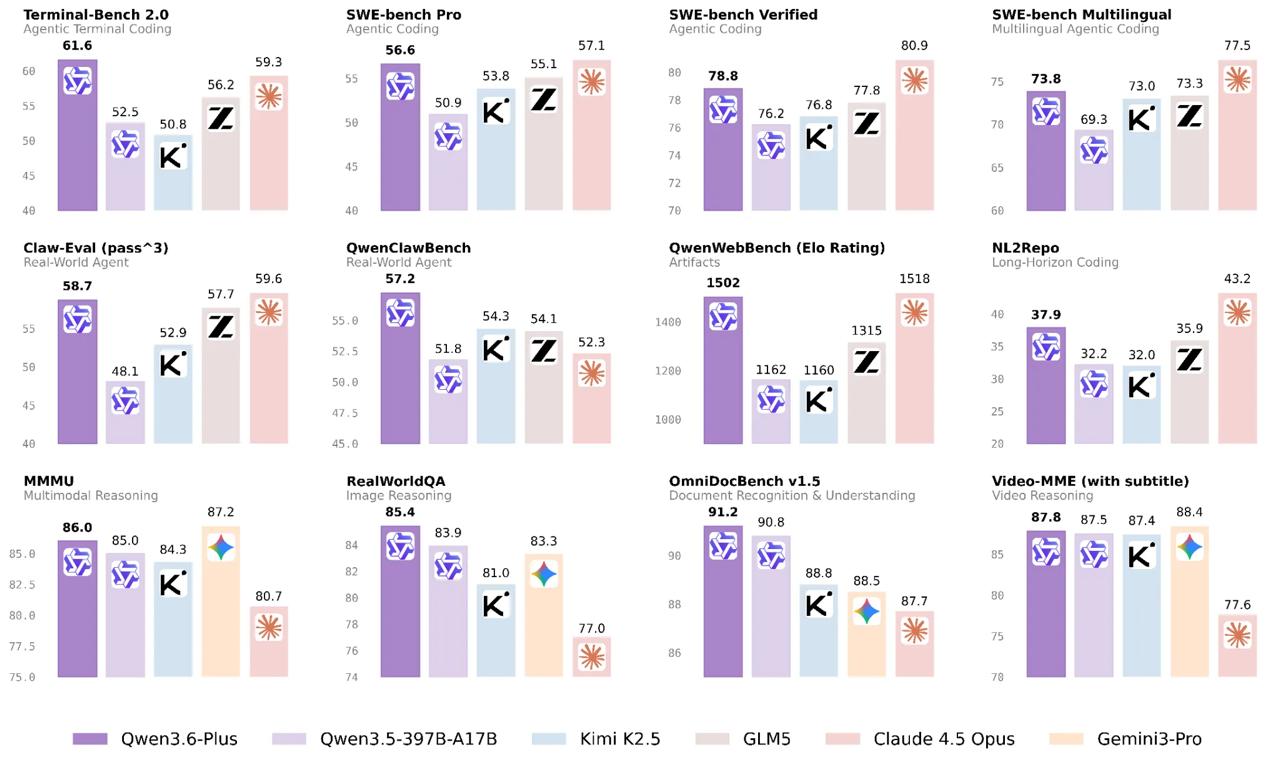

Эксперименты, кстати, показывают, что LeWM действительно учит не ерунду, а нечто похожее на физическую структуру мира. Так что идея, кажется, работает.

www.alphaxiv.org/abs/2603.19312v1

Вставить свои 5 копеек: