Нейросеть, которую боятся Голливуд и Netflix: что умеет Seedance 2.0 и зачем она арбитражникам

Нейросеть, от которой бомбят Голливуд и Нетфликс. Показываем, как Seedance 2.0 уже сейчас снимает рекламу, качает арбитраж и где она все еще валяет дурака

- Что умеет Seedance 2.0: ключевые возможности

- Мультимодальный ввод: собираешь сцену, а не закидываешь промпт

- Автораскадровка: модель думает сценами, а не кадрами

- Motion transfer: показываешь движение вместо того, чтобы его описывать

- Редактирование и сшивка: дорабатываешь готовое, а не генеришь заново

- Встроенное аудио: видео и звук в одной связке

- Физический реализм: почему ролики перестали выглядеть как нейросетка

- Где Seedance 2.0 реально работает: сценарии применения в разных областях

- Seedance 2.0 для арбитража: станок по масштабированию креативов

- Сильные стороны: за что модель выбирают в продакшене

- Слабые места: где Seedance 2.0 ломается о реальность

- Доступ и тарифы: как начать работать с Seedance 2.0

- API и интеграция: как встроить Seedance в свой пайплайн

- Seedance 2.0 vs Runway, Pika и Stable Diffusion: что выбрать

- Seedance 3.0 и рынок: что будет дальше

- Заключение

Seedance 2.0 от ByteDance за пару недель превратилась из «очередной китайской нейросети» в модель, которую обсуждают режиссеры, продюсеры, юристы и маркетологи по всему миру.

Голливуд обвиняет ByteDance в копировании стилей и лиц актеров, правозащитники предупреждают о «фабрике дипфейков», а техно-медиа пишут про реалистичную физику и сцены, неотличимые от дорогого продакшена. Дело дошло даже до того, что Netflix открыто угрожает владельцам Seedance судом.

Кроме того, что для обзора мы запустили шайтан-Seedance сами, еще мы изучили ревью от тех, кто уже погонял модель в продакшене: режиссеров, креаторов, маркетинговых команд и разработчиков с API.

Разберем, чем Seedance отличается от Runway Runway — ИИ-cервис для создания и монтажа видео: генерация сцен, изменение фона, стилизация и постобработка прямо в браузере. и Pika Pika — сервис для быстрой генерации коротких AI‑видео и клипов, ориентированный на соцсети, тренды и простые визуальные эффекты. , как работает мультимодальное управление и автораскадровка, где модель дает реальный режиссерский контроль, а где ломается о реальность. И отдельно — как она меняет рынок: от первых кейсов в рекламе и кино до конфликтов с Голливудом и ожиданий от Seedance 3.0.

Плашка «Читайте также»: Камера не понадобится: подборка лучших нейросетей для генерации видео

Что умеет Seedance 2.0: ключевые возможности

Для начала коротко опишем, что Seedance 2.0 умеет, и как это работает на деле.

Мультимодальный ввод: собираешь сцену, а не закидываешь промпт

Seedance 2.0 сильно отличается от классических text‑to‑video: здесь не закидываешь промпт в черный ящик, а собираешь сцену из нескольких слоев — текста, картинок, коротких видео и аудио. Модель одновременно принимает до девяти изображений, трех коротких роликов и трех аудиофайлов, а текст просто связывает все это в осмысленный нарратив.

Переделанный популярный мем по Звездным Войнам

Картинки отвечают за визуальный язык: палитру, дизайн персонажей, фактуру локаций, общий стиль — от «снято на iPhone» до «блокбастер Marvel-уровня».

Видео-референсы задают пластику движения и поведение камеры: можно буквально показать, как должен танцевать герой или как камера едет по комнате. Аудио задает настроение и ритм — от спокойного саундтрека до агрессивного хардбасс-тектоник-скриллекс type beat, под который Seedance 2.0 выстраивает монтаж и динамику.

Отдельная фишка — система @‑упоминаний и «ролей» для референсов: указываешь, какой клип отвечает за движение, какая картинка — за стиль, а какой трек — за темп сцены.

Модель понимает, какой референс главный, и не сбивает все в кашу. На практике это позволяет, например, за полчаса собрать 15-секундный бренд-ролик из кадра реального офиса со своими коллегами, референса чужой рекламы и фирменного джингла.

Автораскадровка: модель думает сценами, а не кадрами

Seedance 2.0 не думает категориями одного кадра. Модель воспринимает запрос как маленький сценарий:

- разбивает его на серию шотов →

- подбирает крупность, ракурсы и переходы →

- собирает короткий фильм с понятной драматургией.

Автоматическая раскадровка сцен (auto-storyboarding) работает так:

- Описываешь ситуацию в нескольких предложениях — «герой заходит в офис, замечает странный экран, камера приближается к интерфейсу продукта, затем быстрый монтаж результатов».

- Seedance 2.0 сама решает, сколько шотов нужно и как их связать. При этом сохраняется консистентность: герой не меняет лицо и одежду от кадра к кадру, освещение остается ровным, интерьер не плывет при смене планов.

За счет этого модель ощущается ближе к настоящему продакшену: она не рендерит красивые фреймы по отдельности, а выстраивает визуальный рассказ с логикой начала, развития и кульминации. Для рекламных и продуктовых задач это означает, что одним промптом можно собрать 10–20-секундный explain-ролик или тизер — без покадровой генерации и монтажа в стороннем софте.

Вот таким почти адалт-креативом нас встречает Seedance 2.0 — ничего необычного. Из сразу приятного: нормальный перевод на русский

Motion transfer: показываешь движение вместо того, чтобы его описывать

Seedance 2.0 делает агрессивную ставку на motion transfer — перенос движения и работы камеры из референсного клипа в сгенерированную сцену. Вместо того чтобы словами описывать «сложный пролет дрона через узкий коридор» или «боевку в стиле азиатского кино», просто даешь модели короткий пример — и она копирует ритм, амплитуду, углы поворота.

Работает и для персонажей, и для камеры: берешь видео с танцем, заменяешь танцора на бренд-персонажа или цифрового актера и сохраняешь почти ту же хореографию. Вуаля.

Для режиссеров и продюсеров это работает в привычной логике референсов: не нужно изобретать AI-промпты, достаточно показать — «хочу вот так, только в нашем сеттинге». В продакшене это экономит время на препродакшн и тестовые съемки: можно быстро проверить тип движения или постановки, прежде чем вкладываться в сет и актеров.

Редактирование и сшивка: дорабатываешь готовое, а не генеришь заново

Seedance 2.0 умеет аккуратно дорабатывать существующие ролики. Видео можно продлить вперед или назад, сохранив при этом стилистику, ритм и характер движения камеры — так, что зритель не потом не заметит границы между живой и синтетической частью.

Отдельный сценарий — сшивка нескольких клипов в один: модель выравнивает свет, цвет и динамику, сглаживает стыки и подбирает переходы так, чтобы финальный ролик воспринимался как единая сцена. Доступно и локальное редактирование: фон, персонаж или объект можно заменить только в одном отрезке, не пересчитывая ролик целиком — удобно, когда клиенту нужно подправить деталь на финальном этапе.

Для маркетинга и UGC-форматов паттерн простой:

- берешь сырой вертикальный ролик →

- наращиваешь недостающие моменты →

- местами меняешь фон или персонажа →

- подтягиваешь стилистику под бренд-гайд →

- на выходе получаешь версию, которая выглядит как полноценная продакшн-реклама.

Встроенное аудио: видео и звук в одной связке

В отличие от большинства конкурентов, Seedance 2.0 работает с видео и звуком как с единой сцепкой, а не двумя отдельными задачами. Модель одновременно генерирует картинку и звук: базовую музыку, атмосферные шумы, звуковые эффекты и в некоторых сценариях — речь.

Ключевая особенность — синхронизация: загружаешь готовый трек или бит, и Seedance подстраивает монтаж и движение персонажей под ритм, чтобы удары и смена сцен ложились на акценты музыки. Для диалогов и монологов доступен липсинк на разных языках — мимика и артикуляция совпадают с голосом, что важно для рекламных и обучающих видео.

На практике это позволяет закрыть в одном инструменте то, что раньше собирали в связке «генератор видео + монтажка + звуковой софт»: TikTok-ролик или короткая реклама выходят уже достаточно собранными, а финальная доводка в редакторе становится косметикой, а не полноценным постпродакшном.

Физический реализм: почему ролики перестали выглядеть как нейросетка

Одна из причин, почему Seedance 2.0 так активно обсуждают, — заметный шаг вперед в физическом реализме. Модель лучше справляется с гравитацией, инерцией, взаимодействием объектов, водой, дымом и тканями: движения выглядят тяжелее, вещи падают и мнутся правдоподобнее, сложные сцены с дождем или брызгами меньше выдают нейросеть.

По качеству вывода Seedance стандартно работает в режимах 1080p и 2K для продакшн-сценариев, а с экспериментальными режимами более высокого разрешения в зависимости от площадки и тарифов.

Отдельно эксперты отмечают скорость: она выше предыдущей версии 1.5 на 30% при сопоставимом качестве Seedance 2.0 рендерит видео быстрее многих конкурентов. Например, она быстрее не менее нашумевшей Sora в 2-5 раз.

В продакшене это означает больше вариантов за то же время и меньше количество итераций при работе над концептами. Итого модель пригодна не только для красивых демо, но и для рабочих пайплайнов, где важны качество, контролируемость и скорость вывода одновременно.

Где Seedance 2.0 реально работает: сценарии применения в разных областях

Seedance при грамотном подходе уже может делать ролики, неотличимые от реальных

Киновизуализация и проверка концепта до съемок. Режиссеры и продюсеры используют Seedance 2.0 как инструмент для быстрого прувиза previs (от previsualization). Previs / прувиз — это черновой вариант сцены или ролика: простая аниматика или грубый 3D/видео эскиз, который режиссеры и продюсеры делают до финальной съемки или рендера, чтобы быстро проверить идею, ракурсы и ритм. : вместо раскадровок и аниматиков собирают мини-сцены с реальным движением камеры и базовой актерской пластикой. Для независимого кино это способ дешево проверить тон, визуальный язык и ритм. Для крупных студий — возможность вынести спорное решение на тестовый показ в виде почти готового видео.

Короткометражки и нарративная реклама. Благодаря многокадровой генерации и мультимодальному контролю Seedance 2.0 подходит для коротких историй длиной от 10 до 30 секунд, где важна драматургия. Схема тут такая: берешь референсы по стилю, накладываешь движение камеры из удачных роликов, комбинируешь с картинками продукта или персонажа. На выходе — мини-фильм, который можно использовать как рекламной кампании или как дешевый прототип перед полноценной съемкой.

Контент для соцсетей с единым бренд-стилем. Для TikTok, Reels и Shorts Seedance 2.0 решает главную задачу: держать стабильный визуальный почерк при высокой частоте публикаций. Бренды и креаторы загружают референсы фирменных цветов, персонажей и типовых сцен, а затем клонируют удачные форматы под новые инфоповоды. Модель хорошо работает с репликацией шаблонов: берешь вирусный формат, меняешь героев, продукт и текст, а темп, переходы и динамика оригинала остаются на местке.

Обучающие видео и SaaS-объяснялки. Для бизнеса и SaaS Seedance 2.0 полезна не ради эффектных сцен, а ради понятных explain-роликов Короткие объясняющие ролики, которые в простой визуальной форме показывают, как работает продукт, сервис или идея. . Схема: скриншоты или рендеры интерфейса + текстовый сценарий + референс по камере. Показываешь, как «живет» продукт, без съемки экрана и сложной анимации в After Effects.

Сезонные промо без пересъемки. Классическая боль брендов — сезонные кампании: Новый год, Черная пятница, летние распродажи. Seedance 2.0 позволяет взять один базовый визуальный сет и переодеть его под сезон: поменять окружение, одежду персонажей, погоду и праздничные атрибуты. Так можно быстро тестировать несколько концептов и оставлять в медиаплане только те, которые показывают лучшие метрики на небольшой выборке.

UGC-стиль и контент для быстрых запусков. Еще один устойчивый паттерн — ролики «под UGC», которые выглядят как снятые на телефон, но собраны из референсов и/или бренд-гайдов. Берешь реальные или сгенерированные кадры людей, квартир, улиц, добавляешь движение камеры и монтаж, характерный для живых видео — настраиваешь стиль в духе «снял обычный пользователь».

Seedance 2.0 для арбитража: станок по масштабированию креативов

Для маркетологов и арбитражников Seedance 2.0 — это станок по масштабированию креативов, а не просто инструмент для красивых роликов.

Помните: Seedance 2.0 не любит абстрактные запросы: «сделай крутой клип про продукт». Промпт должен быть в формате «субъект → действие → камера → сцена → стиль → ограничения». Чтобы вытянуть из Seedance максимум, придется потратить время на отработку подхода — этот инструмент не для диванных промптеров.

Быстрая генерация пакета A/B-креативов. На основе одного удачного ролика за час собираешь десятки вариаций: меняешь офферы, первые три секунды, персонажей, фон, язык — структура сцены и динамика остаются. Тесты в перформанс-сетках запускаются быстрее, чем при классическом продакшене или ручном ремонтаже.

Если связка сработала, ее клонируют под другие ГЕО и аудитории: меняют внешность персонажей, окружение, локальные элементы и язык озвучки — сценарий и ритм остаются. Для арбитража это способ не сжигать рабочий креатив, а обкатывать его клоны, которые выглядят по-разному, но психологически работают так же.

Адаптация под разные площадки и форматы. Один и тот же сюжет можно переиграть под разные форматы: вертикаль/горизонталь, 6/15/30 секунд, агрессивный монтаж для TikTok или спокойный для YouTube и т. д. Это убирает ручную перекомпоновку и позволяет запускать кампанию сразу в нескольких сетках с нативно выглядящими креативами.

Псевдо-UGC: ролики с трясущейся камерой, бытовыми интерьерами и живой мимикой, которые при этом точно соответствуют скрипту и офферу. Такие видео пробивают баннерную слепоту Явление, когда пользователи сознательно или подсознательно игнорируют элементы страницы, похожие на баннерную рекламу, даже если там может быть полезная информация. и при этом управляемы с точки зрения посыла.

Тестирование новых офферов. Вместо долгого согласования продакшена — за день собираешь пачку роликов под разные офферы, прогоняешь через трафик и по результатам дорабатываешь ленды и креативную концепцию. Логика такая: сначала валидируешь идею на дешевых AI-креативах, потом при необходимости снимаешь дорогую версию — опираясь на цифры, а не интуицию.

Локализация и работа с разными ГЕО. Встроенный липсинк и поддержка нескольких языков позволяют быстро делать локализованные версии: меняешь озвучку и текст на экране, не переснимая актеров. Для арбитражников, работающих сразу по нескольким ГЕО, — это простой способ проверить, как один и тот же креатив отрабатывает в разных странах.

Сильные стороны: за что модель выбирают в продакшене

| Управляемость через референсы | Seedance 2.0 раскрывается, когда с ней работают как с режиссером, а не как с промпт-ботом. Чем чище заданы референсы — изображения для стиля, видео для движения, аудио для ритма, текст с сюжетом, — тем меньше рандома и тем выше шанс получить ролик, близкий к задумке. На сильных референсах модель ведет себя предсказуемее, чем большинство чисто текстовых конкурентов — особенно в рекламе. |

| Контроль на уровне шотов и камеры | Seedance 2.0 позволяет управлять не только тем, что в кадре, но и тем, как это снято. Модель переносит из референсов настройки камеры, ритм и тип движения — так шоты получаются ближе к реальному продакшену: меньше случайных зумов, странных пролетов и плавающего фрейминга. |

| Высокий процент рабочих результатов | Одна из заметных цифр в обсуждениях Seedance 2.0 — заявляемый уровень usable output около 90%, тогда как у прошлых поколений моделей часто говорили о ~20% реально пригодных дублей. Это не официальный стандарт, но в независимых тестах действительно отмечают: с первого захода получается значительно больше рабочих роликов, а меньше попыток уходит в мусор из-за сломанных лиц, глитчей движения или жестких артефактов. |

| Консистентность в коротких форматах | Seedance 2.0 лучше всего работает в коротких форматах с повторяющимися персонажами и брендовыми элементами: рекламные ролики, интро/аутро, тизеры, продуктовые объяснялки. Стабильные лица, одежда, окружение и логика движения камеры — именно здесь модель выигрывает у большинства аналогов. При грамотном промпте и чистых референсах получаются связные 10–30-секундные сцены без прыгающего героя и внезапных смен стиля. |

Слабые места: где Seedance 2.0 ломается о реальность

| Зависимость от качества референсов | Seedance 2.0 хорошо управляется, пока референсы не конфликтуют между собой. Как только в одном запросе смешиваются лица с разными пропорциями, разношерстный свет или разные типы «оптики» (например, телефон и киношный DOF) — модель усредняет все, получается каша. |

| Классические боли AI-видео: руки-крюки, текст, мелкие детали | Как и другие современные модели, Seedance 2.0 спотыкается на мелочах: руки в динамике, тонкая типографика, логотипы под углом, сложные микрожесты. На быстрых монтажах с активным движением такие детали могут плыть или превращаться в артефакты — особенно если занимают мало места в кадре или совпадают с motion blur. |

| Ограничения по длительности и сложным сценам | Seedance 2.0 ориентирована на короткую форму. Длинные последовательности, сцены с множеством персонажей, быстрые смены планов и сложная хореография способны сломать модель. Там, где нужен точный контроль над таймингом и длинными сюжетными дугами, задачу придется резать на отдельные шоты или комбинировать Seedance с традиционным монтажом. Отдельно — ограничения по чувствительному контенту и лицензированию стилей: часть запросов платформа просто не пропустит из-за внутренних политик и рисков по авторскому праву. |

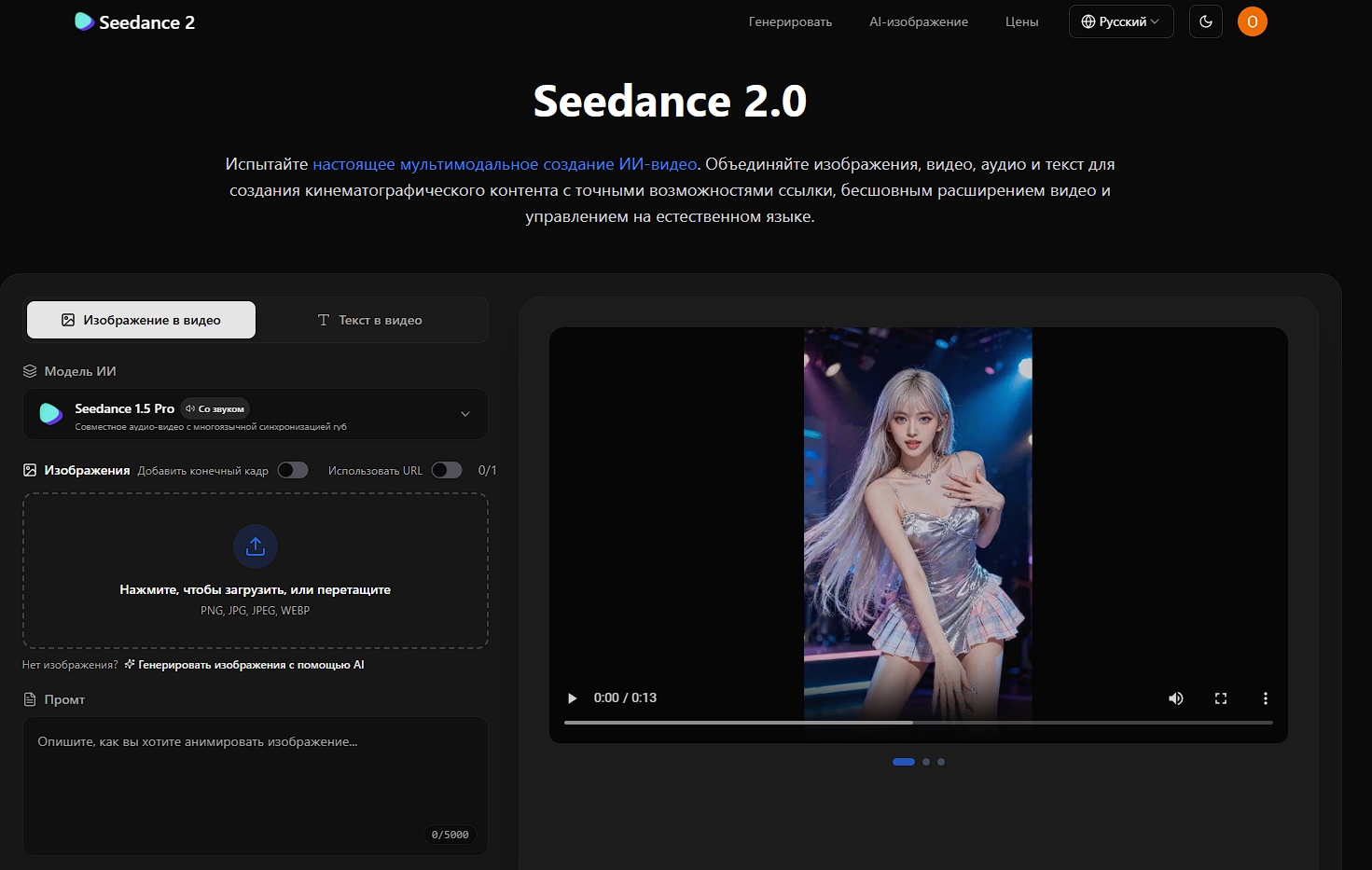

Доступ и тарифы: как начать работать с Seedance 2.0

Seedance 2.0 доступна в нескольких форматах:

- веб-интерфейс,

- интеграции через партнерские платформы,

- прямой доступ через китайское приложение Xiao Yun Que (小云雀) от ByteDance.

Для большинства арбитражников, контентщиков и маркетинговых команд главная точка входа — веб-платформа: личный кабинет с проектами, загрузкой референсов, настройками пресетов и экспортом готовых роликов.

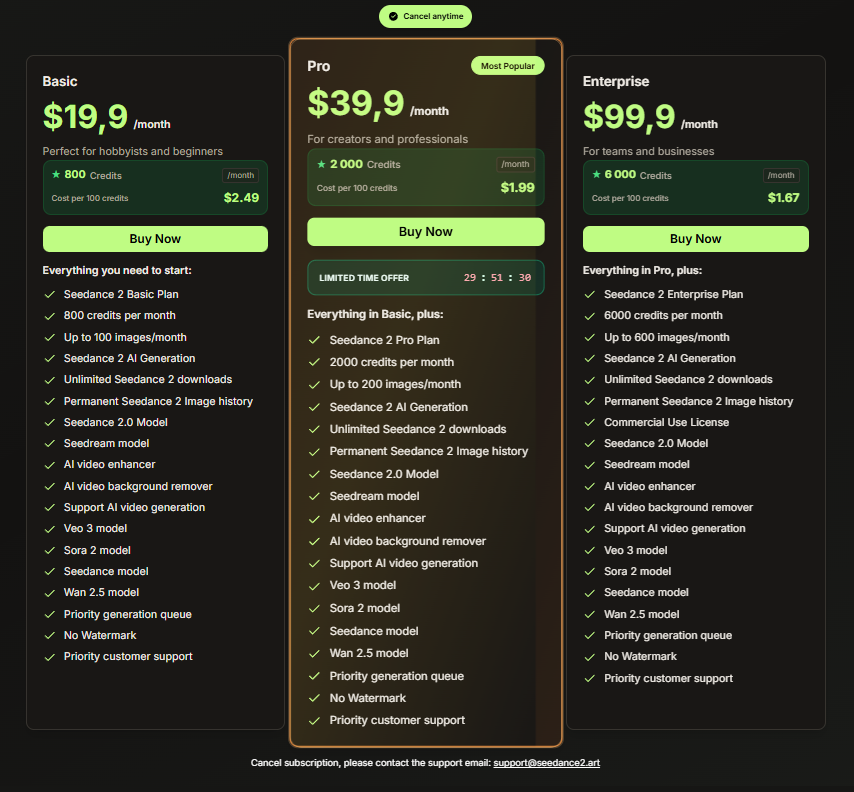

Seedance 2.0 продаётся по кредитной модели с годовой или месячной подпиской и акциями на годовые планы. Базовая логика: вы платите за пакет кредитов в месяц/год, а уже ими оплачиваются генерации (видео, изображения, улучшение и т.д.).

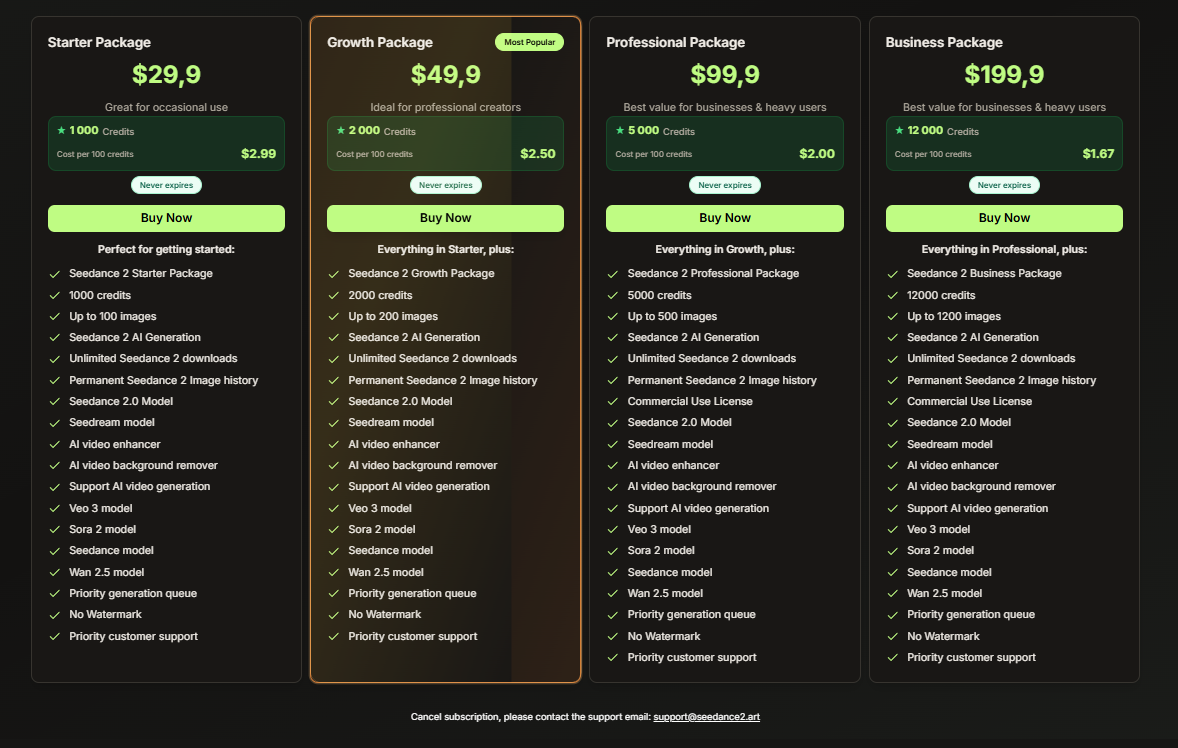

Тарифная линейка стандартная, но с нюансами:

API и интеграция: как встроить Seedance в свой пайплайн

Для команд и разработчиков основной способ встроить Seedance в существующие пайплайны — REST API на стороне Seedance / Dreamina. Через него доступны text-to-video и image-to-video, передача мультимодальных референсов, настройка длительности и разрешения. Все задачи запускаются асинхронно: отправляешь запрос, получаешь task_id и либо опрашиваешь статус, либо ждешь уведомление на вебхук.

Типовой набор эндпоинтов: создание задачи генерации, проверка статуса, получение результата, управление вебхуками. Аутентификация — по API-ключу из кабинета Seedance 2.0 Pro. Для коммерческих сервисов и автоматизированных пайплайнов нужен минимум Pro-план с квотой вызовов и коммерческой лицензией — бесплатный слой для этого не подходит.

На уровне архитектуры Seedance 2.0 можно использовать как бэкенд-движок: маркетинговые платформы автоматически собирают креативы по шаблонам, сервисы видеомаркетинга запускают пачки видео по расписанию, студии встраивают Seedance в продакшн-скрипты наряду с рендер-фермами и монтажными системами.

Seedance 2.0 vs Runway, Pika и Stable Diffusion: что выбрать

Сравнение с конкурентами

Если упростить, Seedance 2.0 играет в той же лиге, что Runway (Gen‑3/4), Pika 2.x и условный стек на Stable Video Diffusion, но ставку она делает на мультимодальность и режиссерский контроль.

| Модель | Ключевая ставка | Сильные стороны | Почему хуже, чем Seedance 2.0 |

| Seedance 2.0 | Мультимодальные референсы + аудио + 2K | Многокадровое повествование, физика, звук, 2K | Ограничения по длительности, кривая обучения |

| Runway Gen‑3/4 | Пост‑обработка, монтаж, инструменты в студии | Гибкий редактор, интеграции, контроль по слоям | Менее выраженная мультимодальность, аудио отдельно |

| Pika 2.x | Скорость и соцсети | Быстрые короткие ролики, простые пресеты | Хуже многокадровый сторителлинг и консистентность |

| Stable Video Diff. | Открытая экосистема, кастомизация | Свобода, локальный рендер, настройка пайплайнов | Слабый «из коробки» контроль, больше тех. трения |

В сравнительных обзорах Seedance 2.0 чаще всего называют лучшим выбором для профессионального продакшена и маркетинга: сочетание 1080p/2K, многокадрового режима, встроенного аудио и высокой консистентности персонажей делает ее удобным комбайном для рекламных и бренд-задач.

Runway при этом сильнее как экосистема: мощный онлайн-редактор, маски, монтаж, инструменты постпродакшена и богатый набор контролов. Хороший выбор, если вы привыкли к классическому видеопродакшену и хотите его дополнить, а не заменить.

Pika выигрывает там, где важны скорость и объем: быстрые короткие клипы под тренды, простые эффектные ролики без сложного нарратива. Stable Video Diffusion и его производные — для тех, кто готов мириться со сложной настройкой ради гибкости, кастомных моделей и локального контроля.

Коротко: если в приоритете режиссерский контроль, многокадровые сцены и встроенный звук, Seedance 2.0 в феврале 2026-го сильнее аналогов. Если нужен полноценный постпрод и монтажный стол в браузере — у Runway больше инструментов вокруг самого генератора. Pika — про скорость и объемы для несложных задач.

Seedance 3.0 и рынок: что будет дальше

В инфополе уже гуляют намеки на Seedance 3.0: ожидают более длинные последовательности, лучшее управление персонажами на уровне проекта и более жесткую интеграцию звука и видео. Параллельно регуляторы и индустрия давят на ByteDance по авторским правам и защите личного образа — модель будет развиваться не только в сторону качества, но и в сторону более строгих ограничений для правообладателей.

На горизонте одного-двух лет системы вроде Seedance станут базовым слоем для продакшена: сначала как стандартный инструмент прувиза и тестов, затем — как источник финальных роликов для digital-кампаний и низкобюджетного контента. Вопрос уже не в том, заменит ли AI съемочную группу, а в том, какие команды быстрее перестроят процессы под сценарный, референс-ориентированный подход — и смогут за счет этого снимать больше и тестировать чаще.

Заключение

Seedance 2.0 — одна из первых моделей, которая ощущается не как игрушка для вирусных роликов, а как рабочий инструмент режиссера, продакшена и маркетинговой команды.

Главная сильная сторона — управляемость: чем лучше продуман сценарий и референсы, тем меньше рандома и тем выше шанс получить ролик, который можно показать клиенту без оговорки «ну это же просто AI-тест».Модель особенно уместна там, где важны короткие, но выразительные истории: рекламные и бренд-ролики, explain-видео, тизеры, UGC-лайк-контент, быстрые концепты для кино и сериалов.

Ограничения никуда не делись — зависимость от качества исходников, требование к структурированным промптам, ограниченная длина и чувствительность к конфликтующим референсам. Заменить съемочную группу одной кнопкой она по-прежнему не может.

Если вы креатор, маркетолог или продюсер, готовый работать в категориях сценария, раскадровки и референсов, Seedance 2.0 уже сейчас закрывает значимую часть тестов, прувиза и финального продакшена в digital. Если нужен один клик «сделай красиво» без погружения в режиссуру или, наоборот, глубоко интегрированный монтажный стол — смотрите в сторону Pika, Runway или собственного стека на Stable Video Diffusion.

FAQ

Seedance 2.0 доступен бесплатно?

Можно ли использовать ролики в коммерческих проектах?

Насколько сложно освоить Seedance 2.0 без опыта в режиссуре?

Чем Seedance 2.0 отличается от Runway, Pika и Stable Video Diffusion?

Подходит ли Seedance 2.0 для длинных форматов?

Нужен ли API маркетологу или креатору без технического бэкграунда?

Материалы по теме

Вставить свои 5 копеек: